記事

どのようにマルチエージェントのAIコンテンツパイプラインがこのケーススタディページを構築したか

Dec 22

8

モデルのデプロイからリアルタイム推論まで

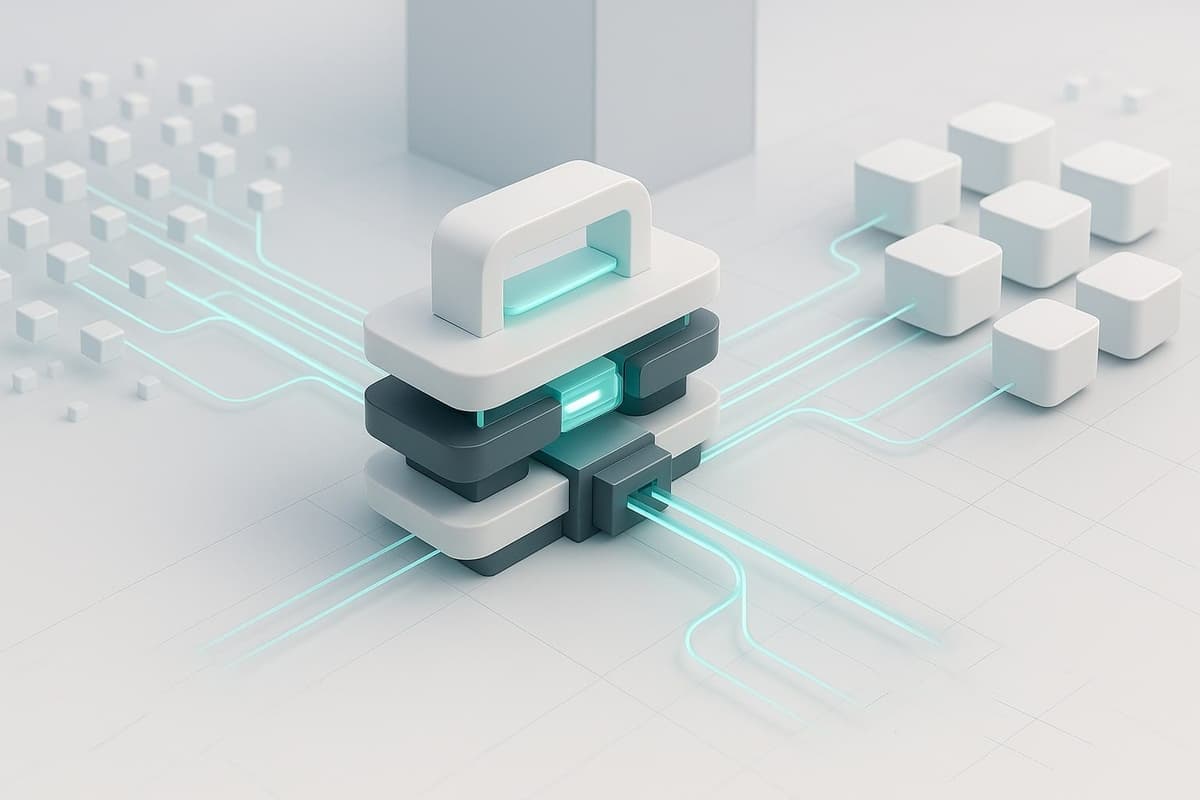

AI統合  知能を結び付ける

知能を結び付ける  実際の本番システムに直接組み込みます。

実際の本番システムに直接組み込みます。

統合は孤立したAIモデルを運用可能なシステムに変えます。統合がなければ、知能はサイロ化され、実際のワークフロー、データ、意思決定の場から切り離されたままになります。

既存のソフトウェアアーキテクチャ、サービス、データパイプラインにAIモデルを組み込む技術的な統合フレームワークです。標準化されたAPI、イベント駆動型インターフェース、オーケストレーション層を通じて、信頼性の高いモデルデプロイ、リアルタイム推論、双方向のデータフローを実現します。本番環境向けに設計されており、バージョン管理されたモデルライフサイクル管理、監視、スケーラビリティをサポートすることで、複雑な分散インフラ内でもAI機能がシームレスかつ安全、効率的に動作することを保証します。